IIZUKA GROUP

飯塚グループIIZUKA GROUP

飯塚グループ

Research Leader

研究代表者

Research Content

研究内容

飯塚グループにおいては主にAI-AI間のPHNコミュニケーションを担当する。既に同グループにおいては複数の限定的な身体性を持ったAIエージェント間において共通表象を共通なDNNで扱う仮想環境内シミュレーションの研究を進めており、このノウハウを活かして本研究ではAI-AI間のPHNコミュニケーションのシミュレーション実証を担当する。

同環境下においてAIエージェントに対して等価的なPHNを構築することから研究を始める。AIエージェントに対して「ヒトにおける感覚/運動/認識表象/それ以外の隠れ情報」を想定し、ヒトと等価な意識下身体性情報の抽出とエージェント間での共有、翻訳可能性/必要性の有無を検討する。同方針のもとで項目4でのAI用の等価PHN構想の実装とAI-AI間のPHN相互学習伝達の検証をシミュレーション上において先行的に担当する。特にシミュレーション研究である利点を活かして、後期での多対多コミュニケーションを視野に入れた検証を進める。

シミュレーションによる4つの研究ステップ

シミュレーションによる

4つの研究ステップ

1

PHN構築とAIへの適用

既存の深層学習技術および限定的身体性を持つエージェント間のDNN共通表象生成のノウハウを基盤とし、AI間の「等価的PHN(パラサイトヒューマンNEXT)」を構築する。シミュレーション上に身体を持つエージェントを実装し、前田グループが過去に提案しているつもり制御のフレームワークを利用することで、入力出力信号の背後に潜むエージェントのコミュニケーションシグナルを抽出する。この抽出にDNNを利用し、従来の手法よりも精度よくシグナルを抽出可能にする。

2

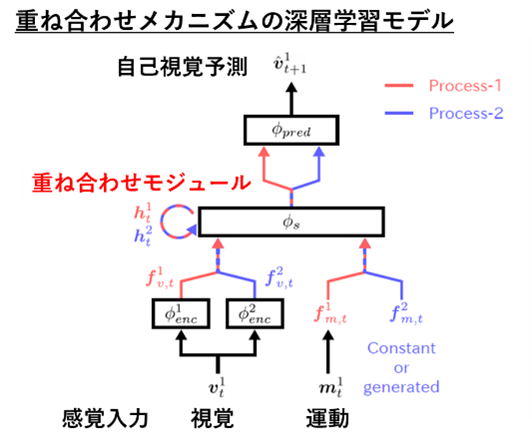

相互翻訳機能と自他重ね合わせモデルの導入

さらに深層学習による「自他重ね合わせモデル」の運用実績を活かし、AIエージェント同士が自己と他者を区別せずに内的状態を共有し、相互理解を深化させる枠組みを設計する。これにより、単なる模倣や明示的制御ではなく、エージェント間の「共通表象形成」と「意図共有」を実現する。具体的には、各エージェントの認知構造や動機を、PHNチャネルを介して他エージェントに伝達する仕組みを構築し、シミュレーション環境内でその有効性を検証する。

3

多対多相互学習とシミュレーション検証

シミュレーション環境においては、AI間の多対多ネットワークを構築し、複数エージェントによる「PHN共有ネットワーク」の学習効果を検証する。従来の単一の視点からの学習を超え、エージェント群が相互に身体性情報(隠れ変数パターン)共有することで、複雑な協働や合意形成が可能となる。この相互作用の安定性や学習収束性についても、固有関数同期モデル(ESM)等の数理的基盤を導入し、理論的および実証的な検証を進める。

4

人を含む多対多のPHNネットワークへの適用

本研究で構築するAI-AI間PHNネットワークは、ヒトやAIとの多対多非言語情報ネットワークと統合されることにより、異種主体間の共生・協働の可能性を理論およびシミュレーション環境で検証する。特に、AI同士が身体性を模倣した隠れ情報の共有を通じて動作調整や意図理解を行い、ヒトやAIとの間でどの程度まで円滑な非言語コミュニケーションを実現できるかを評価する。これにより、複数の主体が同時に参加するPHNネットワークにおいて、相互理解や協働の質を向上させる効果やその限界を明らかにすることを目指す。また、異種AI間での翻訳可能性の検証を通じて、AI同士の協働における学習収束性や相互理解の実現可能性についても評価を行い、将来的な応用可能性を探る。

Research Achievements

代表的な実績

Haruna Kasashima, Wataru Noguchi, Yasumasa Tamura, Masahito Yamamoto, Hiroyuki Iizuka:Shared Encoding and Representation of Tool-Mediated and Direct Touch via Superposition Mechanisms:2025 IEEE Symposium Series on Computational Intelligence in Artificial Life and Cooperative Intelligent Systems, Mar. 2025.

Haruna Kasashima, Wataru Noguchi, Yasumasa Tamura, Masahito Yamamoto, Hiroyuki Iizuka:A Deep Learning Approach to Understanding the Integration of Tools into Body Schema:ALIFE 2024: Proceedings of the 2024 Artificial Life Conference, Jul. 2024.

Ryoma Shinto, Hiroyuki Iizuka:Analyzing the Sensibility of Visual Language Models Using an Evolving Image Generation System: Focusing on Color Impressions and Sound Symbolism:ALIFE 2024: Proceedings of the 2024 Artificial Life Conference, Jul. 2024.

西岡拳, 野口渉, 飯塚博幸, 山本雅人:動物園のゾウを対象にした単一監視カメラ映像によるトラッキング手法の検討と実践:情報処理学会論文誌デジタルプラクティス(TDP), Vol. 5, No. 3, pp. 60–69, Jul. 2024.

Hayto Terao, Wataru Noguchi, Hiroyuki Iizuka, Masahito Yamamoto:Multi-stream Single Network: Efficient Compressed Video Action Recognition with a Single Multi-input Multi-output Network:IEEE Access, Vol. 12, pp. 20983–20997, Feb. 8, 2024.